从一行代码到智能系统:LangGraph路由器模式的深度解析

从一行代码到智能系统:LangGraph路由器模式的深度解析

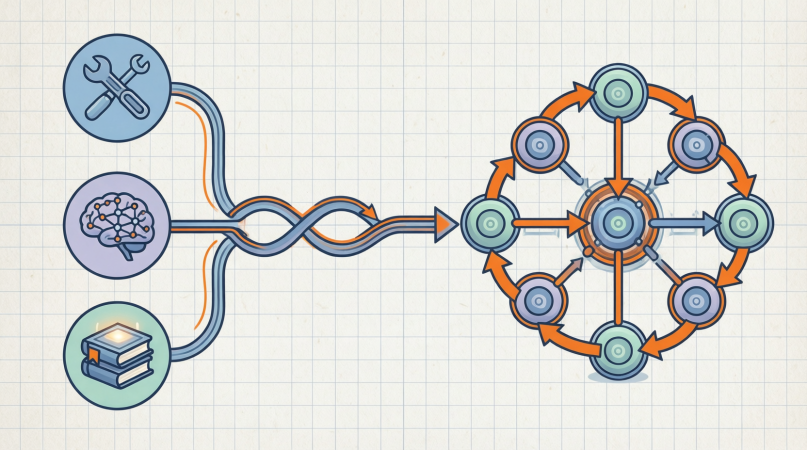

在AI技术快速发展的今天,如何让大语言模型智能地决定何时使用工具、何时自己回答?LangGraph的路由器模式给出了一个优雅的解决方案。让我们一起深入探索这段代码背后的智能奥秘。

一、环境配置:智能系统的基石

任何强大的AI系统都需要稳定的基础,我们从环境配置开始:

1 | def _set_env(var: str): |

设计哲学:

- 安全性优先:使用

getpass隐藏敏感信息输入 - 灵活性:支持自定义代理地址,适应不同部署环境

- 可移植性:环境变量配置使代码易于在不同环境迁移

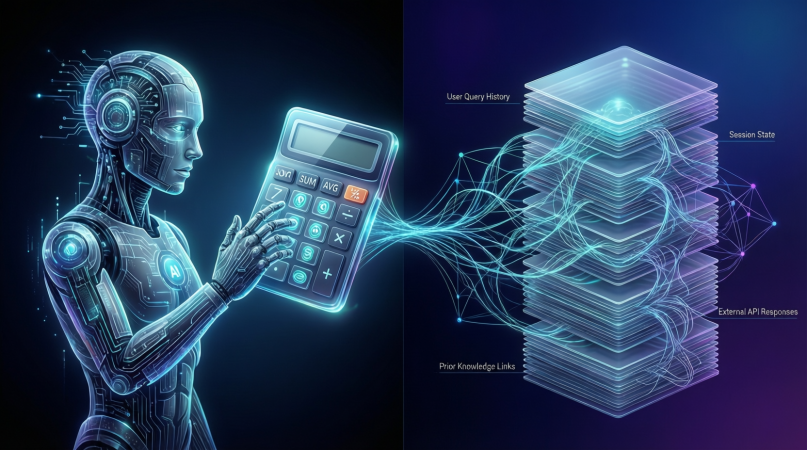

二、核心组件:工具与大语言模型的结合

1. 工具定义:赋予AI执行能力

1 | def multiply(a: int, b: int) -> int: |

关键点:

- 类型注解:

a: int, b: int明确指定参数类型 - 文档字符串:详细的说明让AI理解工具的用途

- 单一职责:每个工具只做一件事,保持简洁

2. 模型初始化:选择合适的大脑

1 | # 使用deepseek-chat模型 |

为什么选择deepseek-chat?

- 优秀的工具调用能力

- 对中文支持良好

- 性价比高

3. 工具绑定:AI的”技能学习”

1 | # 这行代码是魔法开始的地方 |

发生了什么?

- 模型被”告知”有一个可用的乘法工具

- 模型学习工具的调用格式:

multiply(a, b) - 模型获得判断能力:知道何时应该使用这个工具

三、LangGraph架构:构建智能决策流水线

1. 状态设计:对话的”记忆体”

1 | from langgraph.graph import MessagesState |

状态的重要性:

- 保持对话连贯性

- 支持多轮交互

- 跟踪工具调用历史

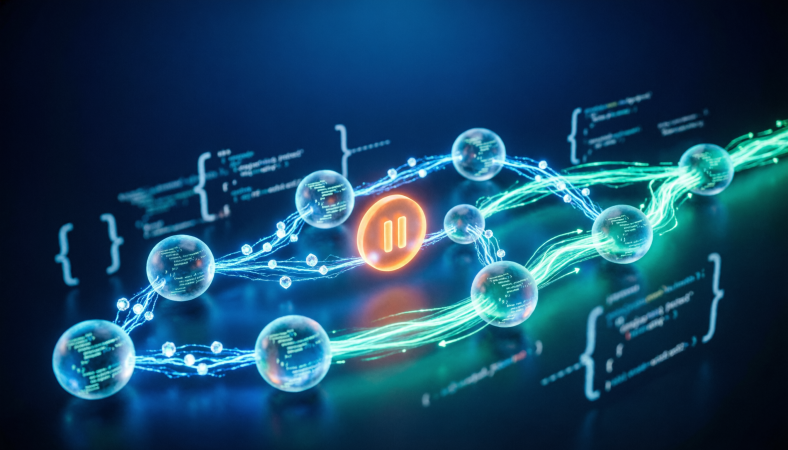

2. 节点设计:流水线的各个工位

节点1:智能决策节点

1 | def tool_calling_llm(state: MessagesState): |

在这个节点中,AI执行关键的判断逻辑:

- 分析用户问题的意图

- 评估自身知识能否回答

- 判断是否有合适的工具可用

节点2:工具执行节点

1 | from langgraph.prebuilt import ToolNode |

这是一个预构建的节点,专为工具执行设计:

- 自动解析工具调用指令

- 安全执行工具函数

- 将结果格式化为AI可理解的消息

3. 条件路由:智能分流的关键

1 | from langgraph.prebuilt import tools_condition |

tools_condition的奥秘:

1 | # 简化理解版 |

四、完整流程图解:智能决策的全过程

graph TD

A[start] --> B[too_calling_llm]

B --> C[end]

B --> D[tools]

D --> C五、实战测试:见证智能决策

测试1:数学计算问题

1 | messages = [HumanMessage(content="Hello, what is 2 multiplied by 2?")] |

输出示例:

1 | 步骤 1: Human - Hello, what is 2 multiplied by 2? |

测试2:概念解释问题

1 | messages = [HumanMessage(content="解释LangGraph中的路由器模式")] |

六、深入原理:模型如何学会判断

1. 提示词工程(幕后发生)

当调用llm_with_tools.invoke()时,模型实际收到的是结构化提示:

1 | 你是一个AI助手,可以调用以下工具: |

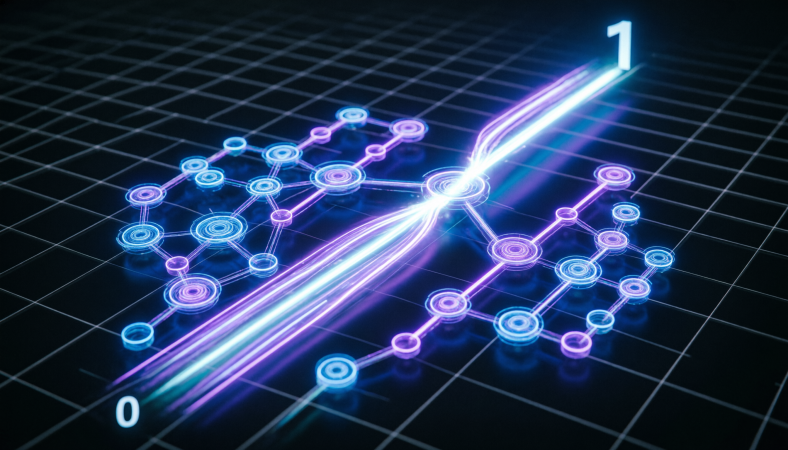

2. 模型的推理过程

1 | # 伪代码展示模型思考过程 |

七、扩展思考:从简单到复杂

1. 多工具场景

1 | # 定义更多工具 |

2. 链式工具调用

1 | # 复杂问题可能需要多个工具 |

3. 工具优先级配置

1 | # 可以告诉AI工具的使用优先级 |

八、最佳实践与调试技巧

1. 清晰的工具描述

1 | def multiply(a: int, b: int) -> int: |

2. 调试输出

1 | # 添加调试信息 |

3. 错误处理

1 | # 增强工具节点的错误处理 |

九、总结:智能决策的艺术

这段代码虽然简短,但展示了AI系统设计的核心思想:

分离关注点:

- AI负责”思考”(是否使用工具)

- 系统负责”执行”(路由决策)

- 工具负责”操作”(具体功能)

智能路由:

- 不是硬编码规则

- 基于AI的实时判断

- 动态适应不同场景

可扩展架构:

- 轻松添加新工具

- 支持复杂决策流程

- 易于调试和维护

十、未来展望

这个简单的路由器模式是通往更复杂AI系统的起点:

1 | # 未来的智能系统可能包含: |

通过这段代码的学习,我们看到:真正的AI智能不是替代人类思考,而是在理解人类意图的基础上,智能地选择最合适的响应方式。 LangGraph的路由器模式正是这一理念的完美实践,它将复杂的决策过程封装在简洁的代码中,让每个开发者都能构建出理解”分寸”的AI系统。

本博客所有文章除特别声明外,均采用 CC BY-NC-SA 4.0 许可协议。转载请注明来源 Nosaw博客!

评论